20MINUTOS.ES

- Utilizando una imagen fija, la IA puede crear videos muy realistas de personas hablando.

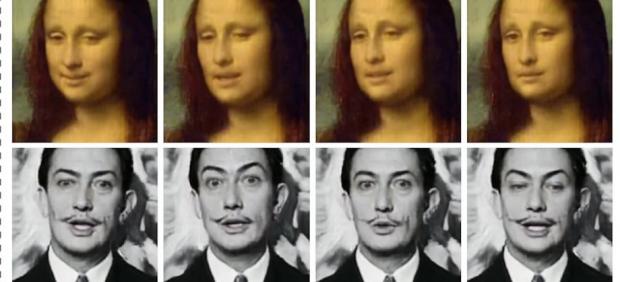

Una investigación de Samsung ha desarrollado una red neuronal capaz de convertir una imagen fija (ya sea un retrato o una fotografía) en un video hiperrealista. Para ser conscientes de lo que han conseguido, puedes ver su artículo Aprendizaje adverso de pocas tomas de modelos realistas de cabezas parlantes neuronales, en el que la Mona Lisa o Albert Einstein aparecen hablando.

Los desarrolladores del centro de inteligencia artificial de la compañía, en Moscú, lograron dar vida en varios vídeos a varias celebridades a raíz de una imagen fija. La "red de convolución profunda", como llaman ellos a la IA en una entrevista con Vice.

El sistema identifica ciertos rasgos faciales y luego los utiliza para animar la imagen fija, tal y como muestra el vídeo que ha compartido en YouTube uno de los investigadores, Egor Zakharov.

Aunque la IA es capaz de proporcionar movimiento a una imagen, cuantos más información le des, mejor creará el vídeo. Es decir, si en vez de utilizar solo una fotografía como base, fuesen dos o tres, la animación sería mucho más realista.

Para las pruebas que han realizado, el equipo ha cogido imágenes y fotografías de Fydor Dostoevsky, Salvador Dalí, Albert Einstein, Marilyn Monroe e incluso el retrato de la Mona Lisa. La IA pudo animarlos a todos, resultando un divertido vídeo de cinco minutos en el que parecen estar vivos todos.

from Tecnología http://bit.ly/2wpqyBn

Comentarios: